Metrikbasierte Bewertung

Verfügbar für Pro- und Enterprise-Pläne

Die metrikbasierte Evaluierung ist für Pro- und Enterprise-Pläne verfügbar. Registrierte Community-Nutzer und Nutzer des Starter-Plans können sie ebenfalls innerhalb eines einzelnen Workflows verwenden.

Was ist eine metrikbasierte Evaluierung?

Sobald ein Workflow bereit für die Bereitstellung (Deployment) ist, möchten Sie ihn in der Regel mit mehr Beispielen testen als während der Entwicklungsphase.

Beispielsweise möchten Sie Randfälle, die in Produktionsausführungen auftreten, Ihrem Testdatensatz hinzufügen, um sicherzustellen, dass diese abgedeckt sind.

Bei großen Datensätzen, die auf Produktionsdaten basieren, ist es schwierig, allein durch visuelle Prüfung der Ergebnisse die Gesamtleistung zu beurteilen. Stattdessen müssen Sie die Leistung quantitativ messen. Die metrikbasierte Evaluierung ermöglicht es Ihnen, jeder Testausführung eine oder mehrere Bewertungen zuzuweisen und diese mit früheren Ausführungen zu vergleichen. Die einzelnen Bewertungen werden aggregiert, um die Gesamtleistung über den gesamten Datensatz hinweg zu messen.

Mit dieser Funktion können Sie Evaluierungen durchführen, bei denen Metriken berechnet werden, Veränderungen dieser Metriken zwischen verschiedenen Ausführungen verfolgen und tiefgehend analysieren, was diese Veränderungen verursacht hat.

Metriken können deterministische Funktionen sein (z. B. die Editierdistanz zwischen zwei Zeichenketten) oder mithilfe von KI berechnet werden. In der Regel vergleichen Metriken die Ausgabe mit einer Referenzausgabe (auch als Ground Truth (Referenzdaten) oder Daten-Benchmark bezeichnet). Dafür muss der Datensatz diese Referenzausgabe enthalten. Allerdings benötigen einige Evaluierungen keine Referenzausgabe (z. B. bei der Analyse der Stimmung oder schädlicher Inhalte in Texten).

Funktionsweise

Zu Google Sheets-Anmeldedaten

Evaluierungen verwenden Tabellen oder Google Sheets zur Speicherung von Testdatensätzen. Um Google Sheets als Quelle für Ihren Datensatz zu nutzen, konfigurieren Sie bitte entsprechende Google Sheets-Anmeldedaten.

- Leichte Evaluierung einrichten

- Metriken zum Workflow hinzufügen

- Evaluierung durchführen und Ergebnisse prüfen

1. Leichte Evaluierung einrichten

Folgen Sie den Einrichtungsanweisungen, um einen Datensatz zu erstellen, diesen mit Ihrem Workflow zu verbinden und die Ausgabe wieder in den Datensatz zurückzuschreiben.

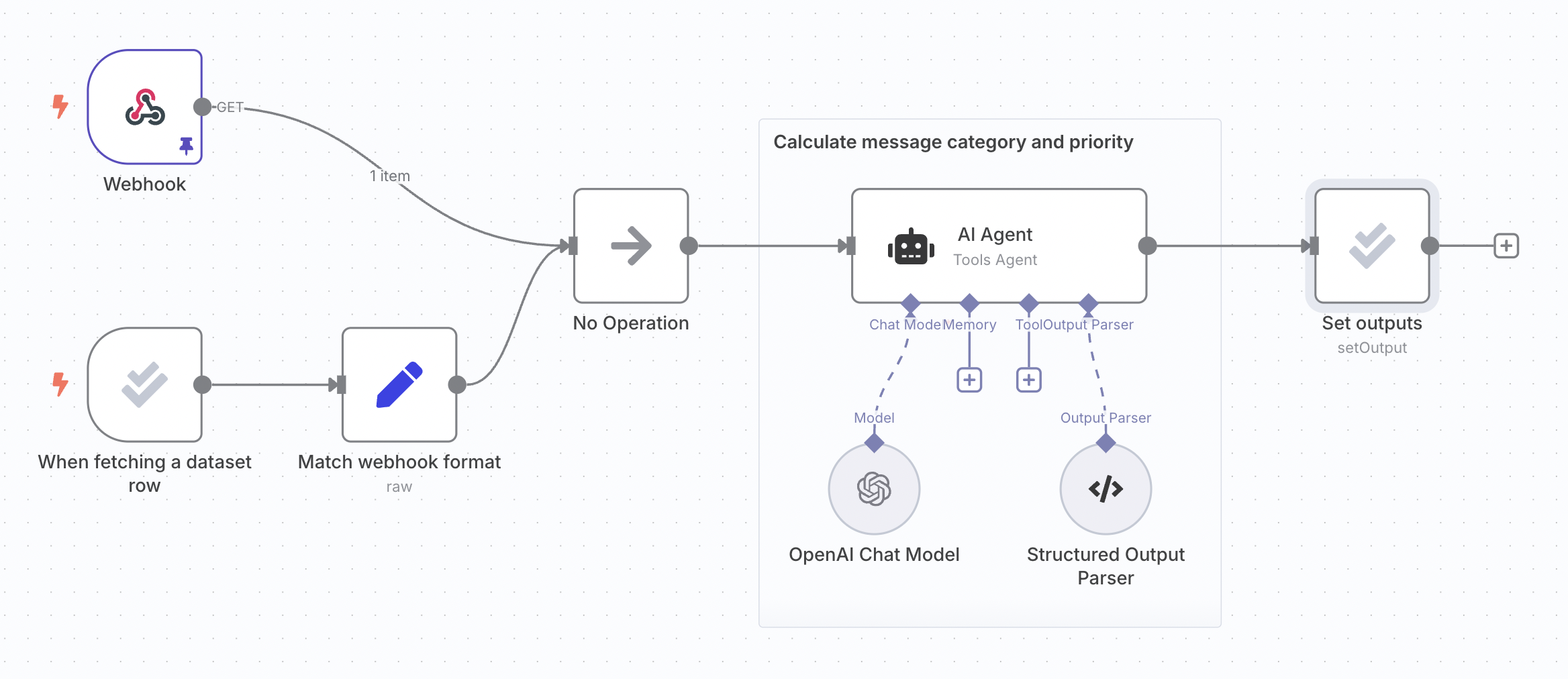

Die folgenden Schritte verwenden denselben Beispiel-Workflow zur Support-Ticket-Klassifizierung wie im Dokument zur leichten Evaluierung:

2. Metriken zum Workflow hinzufügen

Metriken sind Dimensionen, anhand derer die Ausgabe Ihres Workflows bewertet wird. In der Regel vergleichen sie die tatsächliche Workflow-Ausgabe mit einer Referenzausgabe. Es ist üblich, KI zur Berechnung von Metriken zu verwenden, aber manchmal können Metriken auch direkt per Code berechnet werden. In n8n sind Metriken stets numerisch.

Sie müssen die Logik zur Berechnung der Metriken an einer Stelle im Workflow hinzufügen, die nach der Erzeugung der Ausgabe liegt. Jede Referenzausgabe, die Ihre Metriken benötigen, können Sie als Spalte in Ihren Datensatz einfügen, damit sie im Workflow verfügbar ist (da der Evaluierungs-Trigger den Inhalt des Datensatzes in den Workflow ausgibt).

Verwenden Sie die Aktion Metriken festlegen, um folgende Metriken zu berechnen:

- Correctness (Korrektheit, KI-basiert): Entspricht die Bedeutung der Antwort der bereitgestellten Referenzantwort? Bewertungsskala von 1 bis 5, wobei 5 am besten ist.

- Helpfulness (Hilfreichkeit, KI-basiert): Beantwortet die Antwort die gestellte Anfrage? Bewertungsskala von 1 bis 5, wobei 5 am besten ist.

- String Similarity (Zeichenkettenähnlichkeit): Wie ähnlich ist die Antwort der Referenzantwort auf Zeichenebene (basierend auf der Editierdistanz)? Gibt einen Wert zwischen 0 und 1 zurück.

- Categorization (Kategorisierung): Stimmt die Antwort exakt mit der Referenzantwort überein? Gibt 1 bei Übereinstimmung, sonst 0 zurück.

- Tools Used (Verwendete Tools): Wurden bei der Ausführung Tools verwendet? Gibt einen Wert zwischen 0 und 1 zurück.

Sie können auch benutzerdefinierte Metriken hinzufügen: Berechnen Sie die Metrik innerhalb Ihres Workflows und ordnen Sie sie dann dem Evaluierungsknoten zu. Verwenden Sie hierfür die Aktion Metriken festlegen und wählen Sie Benutzerdefinierte Metriken aus. Anschließend legen Sie Name und Wert der zurückzugebenden Metrik fest.

Beispiel:

- RAG-Dokumentrelevanz: Bei Verwendung einer Vektordatenbank – sind die abgerufenen Dokumente relevant für die gestellte Frage?

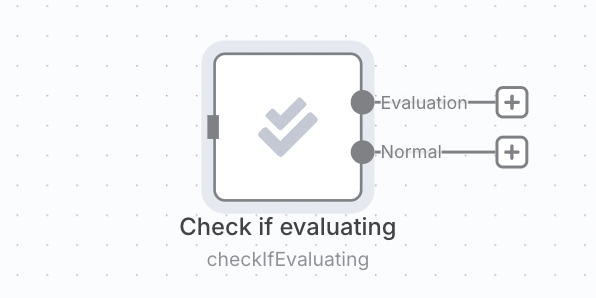

Die Berechnung von Metriken erhöht Latenz und Kosten. Daher möchten Sie diese möglicherweise nur bei Evaluierungsläufen durchführen und bei Produktionsausführungen überspringen. Dies erreichen Sie, indem Sie die Metriklogik hinter dem Knoten Prüfen, ob evaluiert wird platzieren.

3. Evaluierung durchführen und Ergebnisse prüfen

Wechseln Sie zum Evaluierung-Tab Ihres Workflows und klicken Sie auf die Schaltfläche Evaluierung ausführen. Die Evaluierung wird gestartet. Nach Abschluss werden aggregierte Werte für jede Metrik angezeigt.

Sie können auf eine Testlauf-Zeile klicken, um die Ergebnisse der einzelnen Testfälle einzusehen. Durch Klicken auf einen einzelnen Testfall wird die zugehörige Ausführung (in einem neuen Tab) geöffnet, die dieses Ergebnis erzeugt hat.