Évaluation basée sur des indicateurs

Disponible pour les forfaits Pro et Enterprise

L’évaluation basée sur des métriques est disponible pour les forfaits Pro et Enterprise. Les utilisateurs communautaires inscrits ainsi que ceux du forfait Starter peuvent également l’utiliser dans un seul workflow.

Qu’est-ce que l’évaluation basée sur des métriques ?

Lorsqu’un workflow est prêt à être déployé, vous souhaitez généralement le tester sur plus d’exemples que pendant la phase de construction.

Par exemple, lorsque des cas limites apparaissent dans les exécutions en production, vous voudrez les ajouter à votre jeu de données de test afin de vous assurer qu’ils sont tous couverts.

Avec de grands jeux de données construits à partir de données de production, il est difficile d’évaluer visuellement les performances globales. Vous devez mesurer ces performances de manière quantitative. L’évaluation basée sur des métriques attribue une ou plusieurs notes à chaque exécution de test, et permet de les comparer aux exécutions précédentes. Chaque note individuelle est ensuite agrégée afin d’évaluer la performance globale sur l’ensemble du jeu de données.

Cette fonctionnalité vous permet d’exécuter des évaluations qui calculent des métriques, de suivre l’évolution de ces métriques entre différentes exécutions, et d’analyser en profondeur les causes de ces variations.

Les métriques peuvent être des fonctions déterministes (comme la distance d’édition entre deux chaînes de caractères) ou calculées à l’aide de l’intelligence artificielle. Elles consistent généralement à comparer la sortie obtenue avec une sortie de référence (aussi appelée ground truth ou donnée de référence). Pour cela, le jeu de données doit inclure cette sortie de référence. Cependant, certaines évaluations ne nécessitent pas de sortie de référence (par exemple, pour détecter le sentiment ou la présence de contenu nuisible dans un texte).

Fonctionnement

Concernant les identifiants Google Sheets

Les évaluations utilisent des tableaux de données ou Google Sheets pour stocker les jeux de données de test. Pour utiliser Google Sheets comme source de données, configurez les identifiants Google Sheets appropriés.

- Configurer une évaluation légère

- Ajouter des métriques au workflow

- Exécuter l’évaluation et consulter les résultats

1. Configurer une évaluation légère

Suivez les instructions de configuration pour créer un jeu de données, le connecter à votre workflow, et y réécrire les sorties.

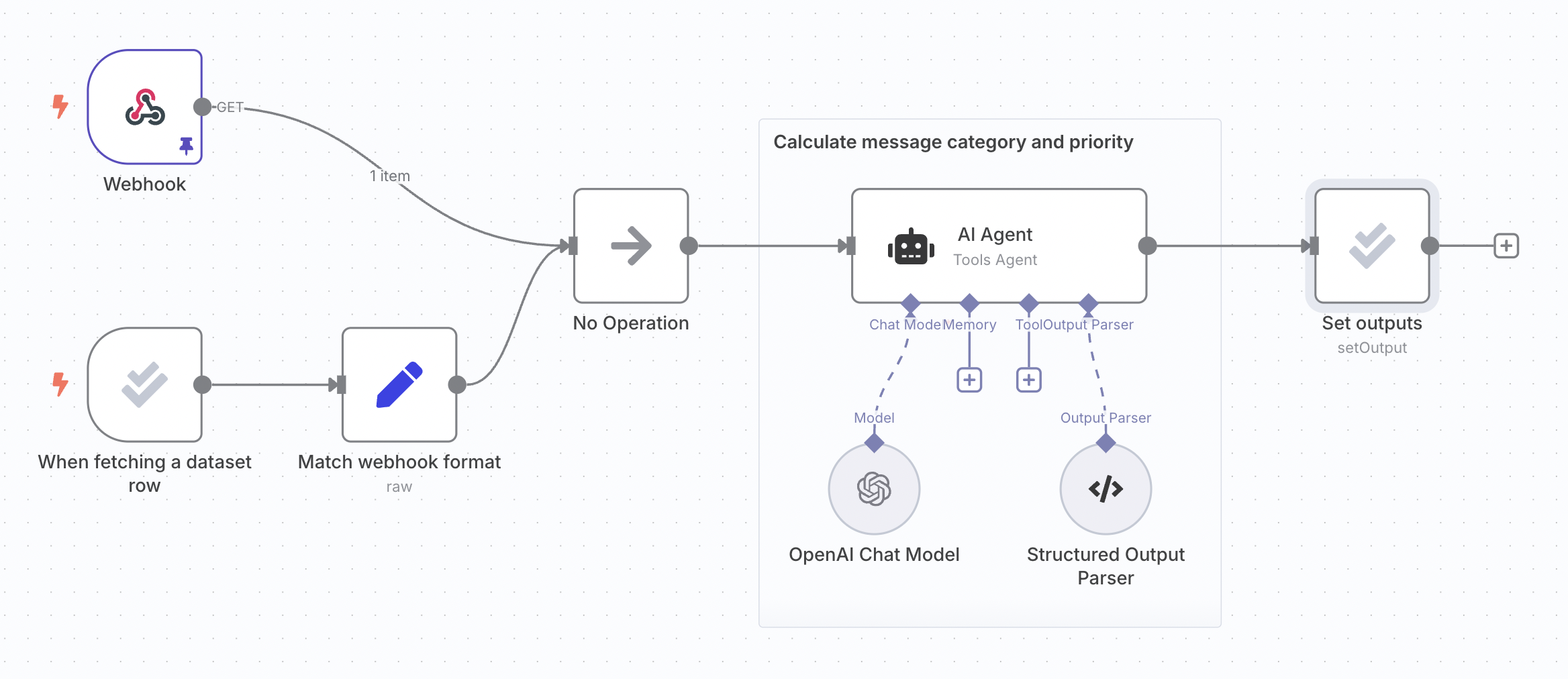

Les étapes suivantes utilisent le même exemple de workflow de classification de tickets d’assistance que dans la documentation sur l’évaluation légère :

2. Ajouter des métriques au workflow

Les métriques sont des dimensions utilisées pour noter la sortie d’un workflow. Elles comparent généralement la sortie réelle du workflow avec une sortie de référence. Il est courant d’utiliser l’IA pour calculer ces métriques, mais parfois du code simple suffit. Dans n8n, les métriques sont toujours numériques.

Vous devez ajouter la logique de calcul des métriques à un endroit du workflow situé après la génération de la sortie. Vous pouvez inclure toute sortie de référence nécessaire comme colonne dans votre jeu de données, afin qu’elle soit disponible dans le workflow (puisque le déclencheur d’évaluation injecte le contenu du jeu de données dans le workflow).

Utilisez l’action Set Metrics (Définir les métriques) pour calculer les métriques suivantes :

- Correctness (Exactitude, basée sur l’IA) : Le sens de la réponse correspond-il à celui de la réponse de référence fournie ? Notée sur une échelle de 1 à 5, 5 étant la meilleure note.

- Helpfulness (Utilité, basée sur l’IA) : La réponse répond-elle à la requête donnée ? Notée sur une échelle de 1 à 5, 5 étant la meilleure note.

- String Similarity (Similarité de chaînes) : À quel point la réponse est-elle proche de la réponse de référence, mesurée caractère par caractère (distance d’édition). Renvoie une note entre 0 et 1.

- Categorization (Catégorisation) : La réponse correspond-elle exactement à la réponse de référence ? Renvoie 1 en cas de correspondance, sinon 0.

- Tools Used (Outils utilisés) : L’exécution a-t-elle utilisé des outils ? Renvoie une note entre 0 et 1.

Vous pouvez également ajouter des métriques personnalisées : calculez la métrique dans votre workflow, puis mappez-la vers le nœud d’évaluation. Utilisez l’action Set Metrics, sélectionnez Custom Metrics (Métriques personnalisées), puis définissez le nom et la valeur de la métrique à renvoyer.

Exemple :

- Pertinence des documents dans un système RAG : Lors de l’utilisation d’une base de données vectorielle, les documents récupérés sont-ils pertinents par rapport à la question posée ?

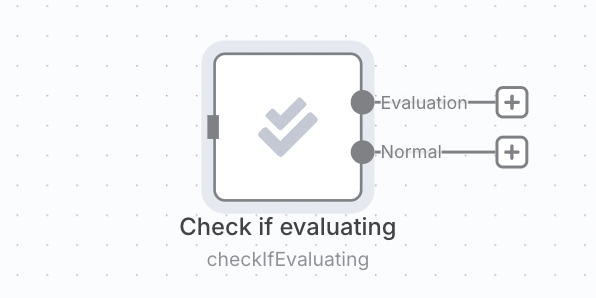

Le calcul des métriques augmente la latence et les coûts ; vous voudrez donc probablement les calculer uniquement lors des évaluations, et les ignorer en production. Pour ce faire, placez la logique de calcul des métriques après l’action Check if Evaluating (Vérifier si une évaluation est en cours).

3. Exécuter l’évaluation et consulter les résultats

Allez dans l’onglet Évaluation du workflow, puis cliquez sur le bouton Run evaluation (Exécuter l’évaluation). L’évaluation commence. Une fois terminée, les scores agrégés pour chaque métrique s’affichent.

Vous pouvez cliquer sur une ligne d’exécution de test pour voir les résultats de chaque cas de test. En cliquant sur un cas de test individuel, vous ouvrirez l’enregistrement de l’exécution ayant généré ce résultat (dans un nouvel onglet).