Evaluación basada en métricas

Disponible en los planes Pro y Enterprise

La evaluación basada en métricas está disponible en los planes Pro y Enterprise. Los usuarios registrados de la comunidad y los usuarios del plan Starter también pueden utilizarla en un único flujo de trabajo.

¿Qué es la evaluación basada en métricas?

Cuando un flujo de trabajo está listo para desplegarse, normalmente deseas probarlo con más ejemplos que los utilizados durante su construcción.

Por ejemplo, cuando las ejecuciones en producción comienzan a mostrar casos extremos (edge cases), querrás añadir esos casos a tu conjunto de datos de prueba para asegurarte de que todos estén cubiertos.

Con conjuntos de datos grandes construidos a partir de datos reales, es difícil evaluar el rendimiento general simplemente revisando visualmente los resultados. Necesitas medir el rendimiento de forma cuantitativa. La evaluación basada en métricas asigna una o varias puntuaciones a cada ejecución de prueba y permite compararlas con ejecuciones anteriores. Cada puntuación individual se agrega para medir el rendimiento general sobre todo el conjunto de datos.

Esta funcionalidad te permite ejecutar evaluaciones que calculan métricas, rastrear cómo cambian dichas métricas entre distintas ejecuciones y analizar en profundidad las causas de esos cambios.

Las métricas pueden ser funciones deterministas (como la distancia de edición entre dos cadenas) o pueden calcularse mediante inteligencia artificial (IA). Normalmente, las métricas implican comparar la salida generada con una respuesta de referencia (también conocida como ground truth). Para ello, el conjunto de datos debe incluir dicha respuesta de referencia. Sin embargo, algunas evaluaciones no requieren una respuesta de referencia (por ejemplo, al verificar el sentimiento de un texto o si contiene contenido dañino).

Cómo funciona

Sobre las credenciales de Google Sheets

Las evaluaciones utilizan hojas de cálculo o Google Sheets para almacenar los conjuntos de datos de prueba. Para usar Google Sheets como fuente de datos, debes configurar las credenciales de Google Sheets.

- Configura una evaluación ligera

- Añade métricas a tu flujo de trabajo

- Ejecuta la evaluación y revisa los resultados

1. Configurar una evaluación ligera

Sigue las instrucciones de configuración para crear un conjunto de datos, conectarlo a tu flujo de trabajo y escribir la salida de vuelta en el conjunto de datos.

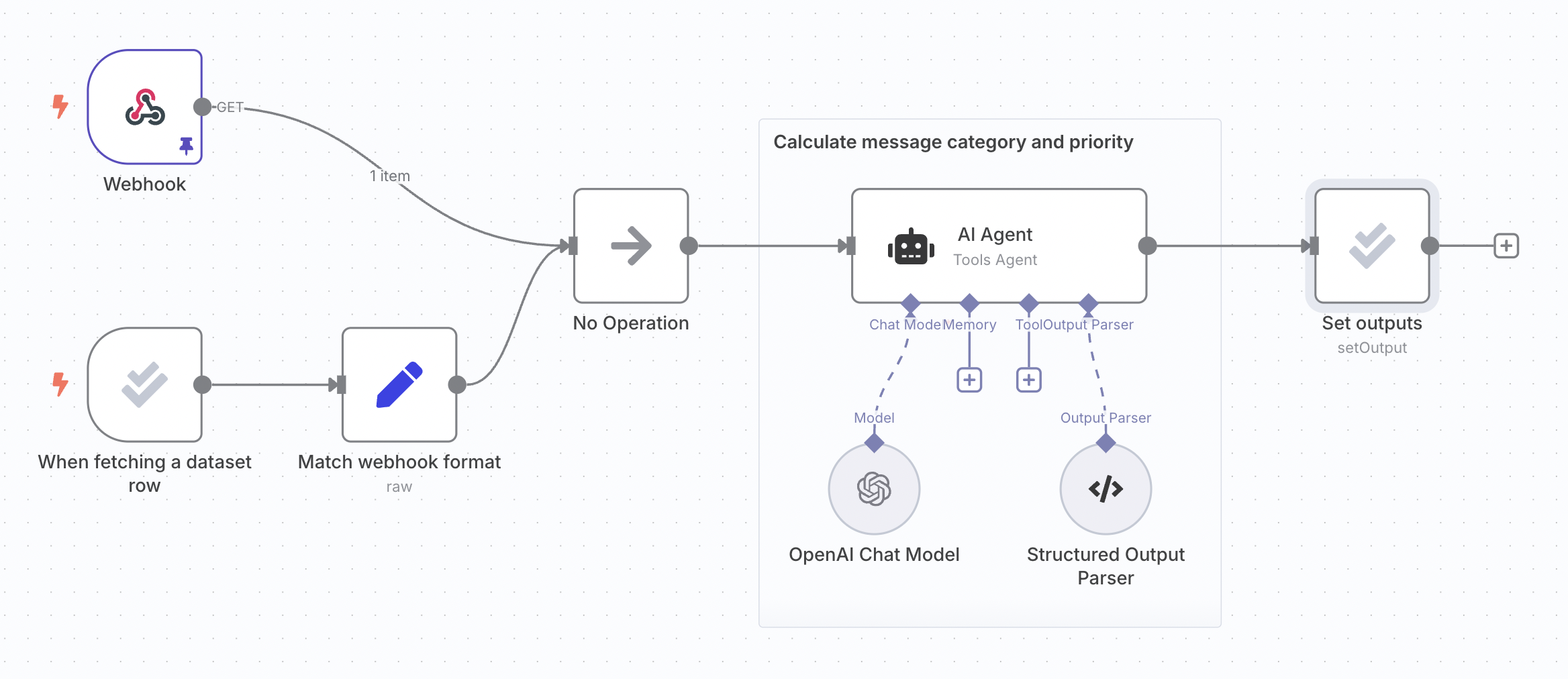

Los siguientes pasos utilizan el mismo flujo de trabajo de ejemplo de clasificación de tickets de soporte descrito en la documentación de evaluaciones ligeras:

2. Añadir métricas al flujo de trabajo

Las métricas son dimensiones utilizadas para puntuar la salida de un flujo de trabajo. Normalmente comparan la salida real del flujo con una respuesta de referencia. Es común usar IA para calcular métricas, aunque a veces también se pueden calcular directamente mediante código. En n8n, las métricas siempre son numéricas.

Debes añadir la lógica para calcular las métricas en algún punto del flujo de trabajo, después de que se genere la salida. Puedes incluir cualquier respuesta de referencia que necesiten las métricas como una columna en tu conjunto de datos, para garantizar que esté disponible dentro del flujo (ya que el disparador de evaluación inyecta el contenido del conjunto de datos en el flujo).

Utiliza el nodo Set Metrics (Establecer métricas) para calcular las siguientes métricas:

- Correctness (Corrección, basada en IA): si el significado de la respuesta es coherente con la respuesta de referencia proporcionada. Se puntúa en una escala de 1 a 5, siendo 5 la mejor puntuación.

- Helpfulness (Utilidad, basada en IA): si la respuesta responde de forma útil a la consulta planteada. Escala de 1 a 5, siendo 5 la mejor puntuación.

- String Similarity (Similitud de cadenas): qué tan cercana es la respuesta a la de referencia, medida carácter por carácter (distancia de edición). Devuelve un valor entre 0 y 1.

- Categorization (Clasificación): si la respuesta coincide exactamente con la de referencia. Devuelve 1 si hay coincidencia, 0 en caso contrario.

- Tools Used (Herramientas utilizadas): si la ejecución utilizó herramientas externas. Devuelve un valor entre 0 y 1.

También puedes añadir métricas personalizadas: calcúlalas dentro del flujo de trabajo y luego asígnalas al nodo de evaluación. Usa el nodo Set Metrics y selecciona Custom Metrics (Métricas personalizadas), luego define el nombre y el valor de la métrica que deseas devolver.

Ejemplo:

- Relevancia de documentos en RAG: al usar una base de datos vectorial, evalúa si los documentos recuperados son relevantes para la pregunta planteada.

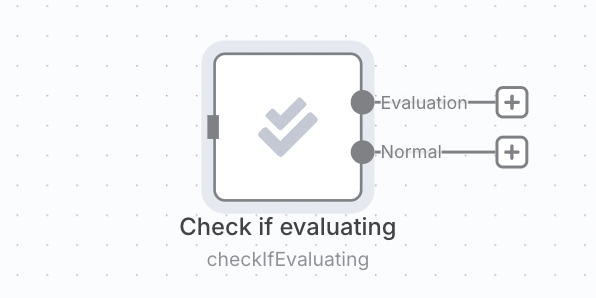

Dado que el cálculo de métricas aumenta la latencia y el coste, es recomendable ejecutarlo únicamente durante las evaluaciones y omitirlo en entornos de producción. Puedes lograrlo colocando la lógica de las métricas después del nodo Check if Evaluating (Comprobar si se está evaluando).

3. Ejecutar la evaluación y ver los resultados

Ve a la pestaña Evaluación del flujo de trabajo y haz clic en el botón Run evaluation (Ejecutar evaluación). La evaluación comenzará a ejecutarse. Una vez finalizada, se mostrarán las puntuaciones agregadas para cada métrica.

Puedes hacer clic en una fila de ejecución de prueba para ver los resultados de cada caso de prueba. Al hacer clic en un caso de prueba individual, se abrirá el registro de ejecución que generó ese resultado (en una nueva pestaña).